Il ruolo del bias nei sistemi di Intelligenza Artificiale

(a cura di Roberto Rocchetti

Nel contesto dell’informatica forense etica e responsabile, il tema del bias nei sistemi di Intelligenza Artificiale assume un rilievo centrale, sia sotto il profilo tecnico-scientifico sia sotto quello giuridico-probatorio.

Per bias si intende una distorsione sistematica nei risultati di un modello, tale per cui le prestazioni non risultano uniformi tra diverse classi o sottoclassi di dati. In ambito forense, ciò implica un rischio concreto: l’utilizzo di strumenti apparentemente accurati che, tuttavia, producono esiti non equi o non affidabili in specifiche condizioni.

Accuratezza apparente e criticità nascoste

Un sistema di AI può presentare elevati livelli di accuratezza complessiva, ma nascondere errori significativi concentrati su determinati gruppi. Studi su sistemi di riconoscimento facciale sviluppati da Microsoft, IBM e Face++ hanno evidenziato come le performance possano variare sensibilmente in funzione delle caratteristiche dei soggetti analizzati.

In particolare, si è osservato che alcune categorie risultano meglio rappresentate e quindi meglio riconosciute dal modello, mentre altre – meno presenti nei dati di addestramento – sono soggette a tassi di errore significativamente più elevati.

Questo porta a una considerazione fondamentale in ambito forense:

l’accuratezza globale non è sufficiente – da sola e senza la supervisione di un esperto- a garantire l’affidabilità probatoria di un sistema di AI.

Origine del bias nei modelli

Le principali cause del bias possono essere ricondotte a:

- Squilibrio dei dati (data imbalance): distribuzione non uniforme delle classi nel dataset;

- Scarsa rappresentatività: i dati non riflettono adeguatamente la realtà osservata;

- Apprendimento di correlazioni spurie: il modello privilegia caratteristiche non rilevanti ai fini dell’analisi;

- Scelte progettuali non adeguate: metriche, architetture o criteri di validazione non coerenti con il contesto applicativo.

Implicazioni in ambito di informatica forense

L’impiego di sistemi di AI in ambito forense – ad esempio per:

- riconoscimento biometrico,

- analisi di immagini e video,

- classificazione automatica di contenuti digitali,

richiede un livello di rigore superiore rispetto ad altri contesti applicativi.

Un sistema affetto da bias può generare:

- falsi positivi o falsi negativi non distribuiti casualmente,

- discriminazioni sistematiche tra soggetti,

- interpretazioni distorte del dato digitale.

Tali criticità incidono direttamente sulla validità, attendibilità e riproducibilità della prova digitale, elementi cardine dell’attività peritale.

Approccio etico e metodologicamente rigoroso

Un approccio conforme ai principi di informatica forense etica e responsabile richiede:

- Analisi critica dei dataset: verifica della completezza e rappresentatività;

- Valutazione delle performance per sottoclassi: non solo metriche aggregate, ma analisi disaggregate;

- Trasparenza ed explainability: comprensione delle logiche decisionali del modello;

- Validazione indipendente e replicabilità: possibilità di verifica da parte di terzi;

- Documentazione dei limiti: esplicitazione delle condizioni in cui il modello può fallire.

In tale prospettiva, il principio guida è il seguente:

L’impiego dell’AI in ambito forense è sempre possibile come strumento di supporto; tuttavia, quando incide direttamente sull’analisi o sull’interpretazione della prova, richiede che i suoi limiti, inclusi i bias, siano esplicitamente conosciuti, verificabili e documentati.

Conclusione

Il bias non rappresenta un’anomalia marginale, ma una componente strutturale dei sistemi di apprendimento automatico, che deve essere analizzata, compresa e gestita con metodo scientifico.

Nel contesto dell’informatica forense, ciò si traduce nell’esigenza di adottare un approccio fondato su:

- evidenza empirica,

- verificabilità,

- rigore metodologico,

- distinzione tra correlazione e causalità.

Solo attraverso tali principi è possibile garantire che l’Intelligenza Artificiale operi come strumento affidabile di supporto all’analisi forense, evitando che diventi, invece, una fonte di errore sistematico o di distorsione interpretativa.

NOTA DI APPROFONDIMENTO SULLA BIAS

Nota tecnica: il bias nelle reti neurali (formalizzazione matematica)

Quando parliamo di AI il più delle volte parliamo anche di reti neurali artificiali (NN, ANN, CNN, ect), il termine bias assume anche un significato strettamente matematico, distinto (ma collegato) al concetto di distorsione nei dati.

In una rete neurale, ogni neurone calcola una combinazione lineare degli ingressi, seguita da una funzione di attivazione. La forma generale è:

y=f(∑i=1nwixi+b)

dove:

- xi sono gli input,

- wi sono i pesi sinaptici,

- b è il bias del neurone,

- f(⋅) è la funzione di attivazione (quella che introduce la non linearità nel modello) ,

- y è l’output.

Interpretazione del bias matematico

Il termine b rappresenta una costante additiva che consente al modello di:

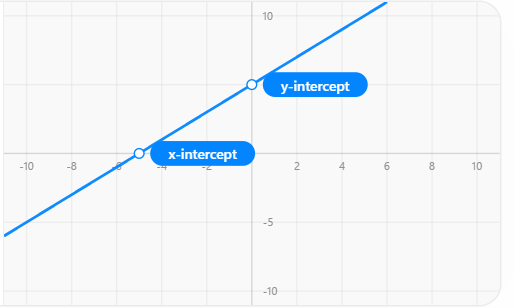

- traslare la funzione di decisione (a scuola la chiamavamo “intercetta”, immagine seguente),

- adattare la soglia di attivazione del neurone,

- rappresentare relazioni non vincolate all’origine.

Senza bias, il modello sarebbe limitato a funzioni che passano per l’origine (0,0), riducendo significativamente la capacità espressiva della rete.

Equivalentemente: senza il termine , la retta sarebbe vincolata a passare per l’origine, limitando la capacità del modello di adattarsi ai dati reali.

Collegamento con il bias “statistico”

Il bias matematico del neurone non è, di per sé, un errore: è un parametro appreso durante il training, al pari dei pesi wi.

Tuttavia, in presenza di:

- dati sbilanciati,

- features non rappresentative,

- correlazioni spurie tra features,

Esempio di sbilanciamento del data set.

Si consideri un sistema di classificazione progettato per individuare contenuti illeciti all’interno di un grande archivio digitale:

- 9.500 file → contenuti leciti

- 500 file → contenuti illeciti

Il dataset è quindi sbilanciato:

- Classe “lecita” = 95%

- Classe “illecita” = 5%

l’ottimizzazione dei parametri wi e b può condurre a funzioni decisionali distorte, che si traducono in errori sistematici su specifiche sottopopolazioni.

In altri termini:

il bias come parametro matematico è lo strumento attraverso cui il modello può anche incorporare bias statistici presenti nei dati.

Implicazione forense del BIAS : cosa si dovrebbe fare?

Dal punto di vista dell’informatica forense, ciò implica che:

- il comportamento del modello non è interpretabile unicamente a livello superficiale;

- è necessario analizzare la funzione decisionale appresa, non solo le performance aggregate;

- eventuali distorsioni osservate nei risultati sono l’effetto congiunto di dati, pesi e bias appresi.

Conclusione

Una volta riconosciuto che un modello può essere affetto da bias, il primo passo non è “fidarsi meno” della AI in modo generico, ma misurare dove, come e quanto il bias si manifesta e partendo da lì procedere tenendo conto dei principi di etica e responsabilità. La presenza di bias si affronta con metodo scientifico: identificazione dei sottogruppi rilevanti, misurazione disaggregata delle prestazioni, formulazione di ipotesi causali, verifica sperimentale, validazione indipendente e documentazione dei limiti residui.

A Cura di Roberto Rocchetti (testo non riproducibile anche per singoli paragrafi)